网心技术 | 基于 OneThingAI 的 OpenClaw 实践

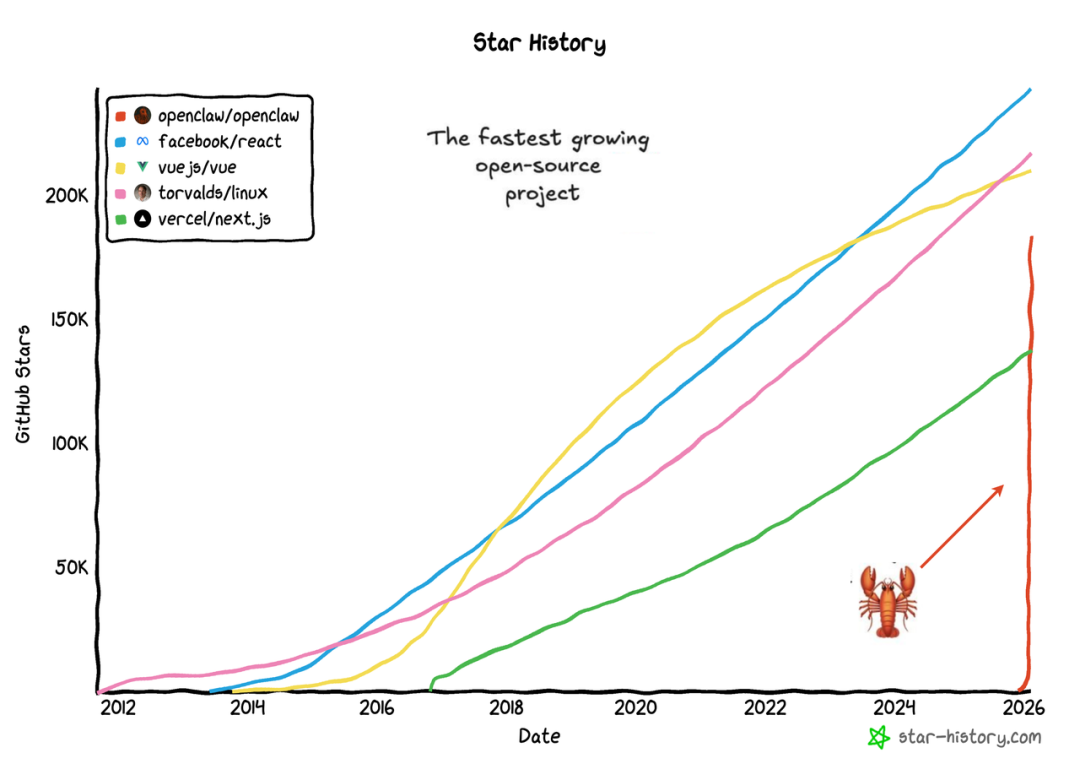

在元宝派内测前夕,AI 智能体工具 OpenClaw(原名 Clawdbot / Moltbot)在海外迎来现象级爆发,短短 2 周内狂揽 GitHub 18.1 万颗星!

图 | star-history

它打破了传统 AI 交互模式,仅凭自然语言就能实现轻量自动化工作(如文件整理、日程管理、跨工具协作等)。隐私安全上,区别于同类 Agent 平台将数据上传云端,隐私安全依赖厂商合规的模式,OpenClaw 100% 本地存储执行、无第三方数据传输,处理机密文件更安全可控。同时网上还有海量一键安装镜像,个人用户可快速部署,极大降低入门门槛。

图 | OpenClaw

但与此同时,这种主打简易部署的设计,短板也很明显 —— 碰上多变的实际工作场景,灵活性就跟不上了,反倒会让后期的调整成本变高。

OneThingAI 针对其在复杂场景中的灵活性不足问题,提供了深度的定制化解决方案、全栈算力服务以及全场景适配,贴合企业与团队实战所需,仅一个账号就能一站式满足 LLM API 调用、GPU算力(本地跑自己模型的诉求)以及 CPU 实例等核心需求。

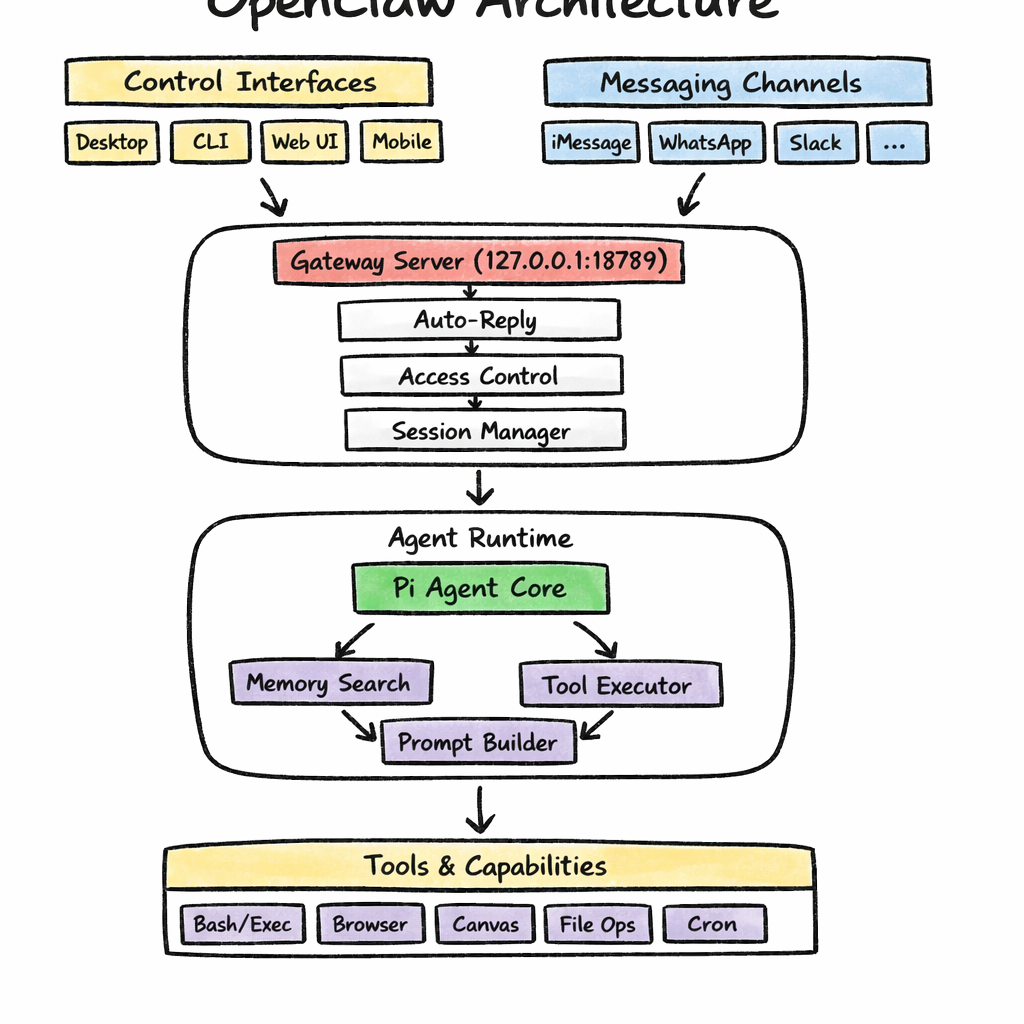

OpenClaw 的系统架构

OpenClaw 的核心模块包含:会话管理、记忆存储、工具沙箱、访问控制和任务编排。智能由模型来提供,OpenClaw 则提供环境。其采用 Hub-and-Spoke 架构,以一个 Gateway 作为Hub,连接用户输入端(iMessage、Slack、WebChat、CLI,微信,飞书等)与 Agent:

- Gateway 是一个服务器,负责对接各类消息平台和控制界面,将路由后的消息分发给 Agent Runtime。

- Agent Runtime 端到端运行 AI 循环:从会话历史和 Memory 中组装上下文,调用模型,对系统提供的能力(如浏览器自动化、文件系统操作、定时任务等)执行工具调用,并持久化更新后的状态。

核心设计:OpenClaw 将接口层(消息来源)与助手运行时(智能与执行所在)解耦。这意味着你可以通过任何日常使用的消息应用,访问拥有同一份记忆的个人 AI 助手,而对话状态和工具访问由你自己的硬件集中管理。如下图:

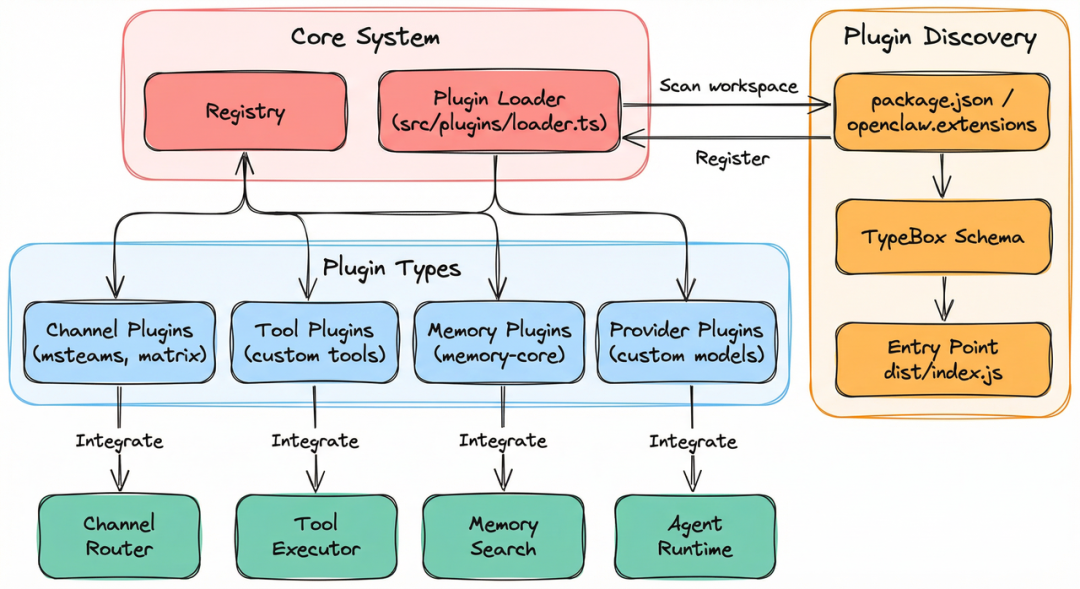

同时,可通过 Plugins 系统,扩展你需要的能力:

- Channel Plugins:额外的消息平台插件(微信, 飞书, QQ 等);

- Memory Plugins:可替换的存储后端插件(向量数据库、知识图谱等);

- Tool Plugins:超出内置 Bash、浏览器和文件操作之外的自定义能力插件;

- Provider Plugins:自定义 LLM 提供商或自托管模型的接入插件。

架构如下:

如何部署 OpenClaw

提示:以下内容仅用于快速验证流程,示例配置未做安全加固,可能包含便于调试的开放策略。请勿直接用于生产/公网;生产环境请按最小权限、HTTPS/TLS、代理与跨域白名单、密钥管理等安全要求重新配置,并参考官方文档进行核验。

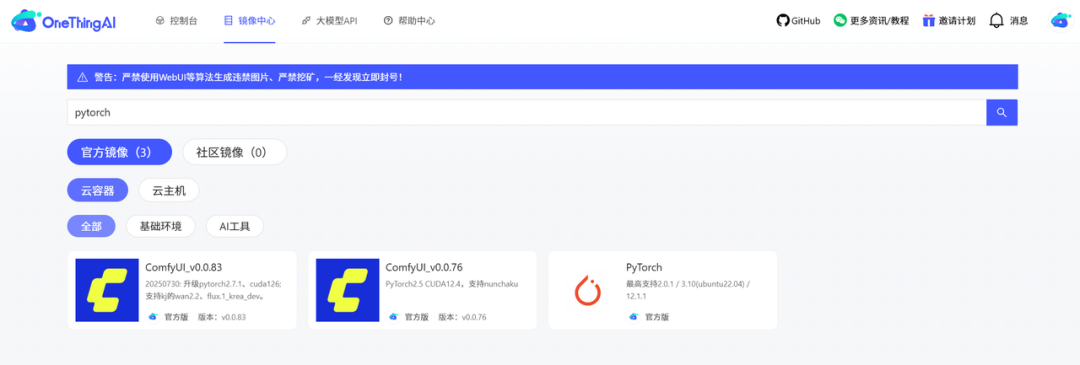

✅ 步骤一:创建镜像

- 进入 OneThingAI 控制台 - 镜像中心,创建 PyTorch 镜像。

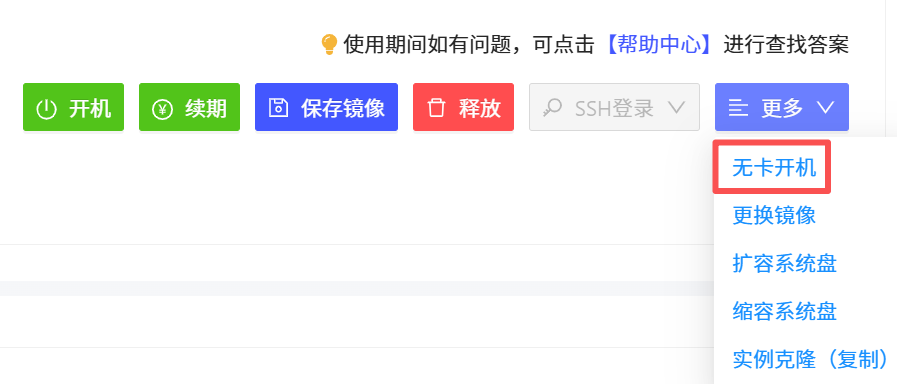

- 选择无卡开机,并打开 Web 终端。(如果想要使用本地的模型,则使用普通开机,这样就可以通过本地 GPU 跑模型,镜像可以选择 Ollama 或者 vLLM,当然也可以通过 PyTorch 镜像安装自己需要的推理引擎)

✅ 步骤二:安装 OpenClaw

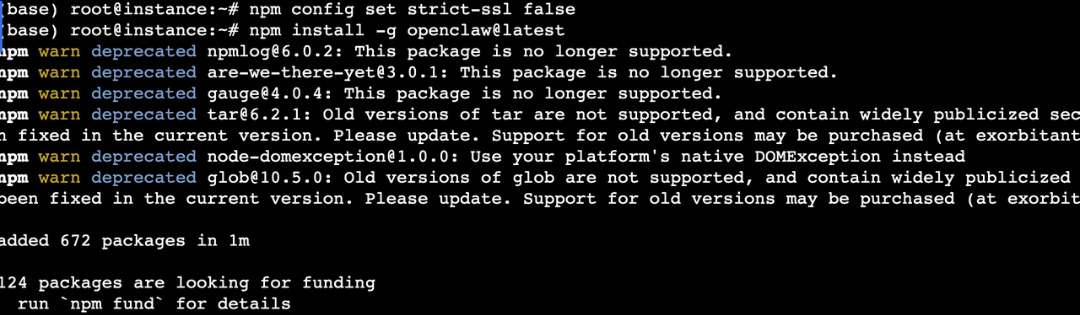

- 安装 nvm 并安装 npm,通过 npm 安装 OpenClaw。

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.1/install.sh | bashsource ~/.bashrcnvm install --ltsnpm config set strict-ssl falsenpm install -g openclaw@latestOpenClaw 是基于 Node.js 开发的工具,官方把它发布到了 npm 官方仓库里,通过 npm 安装是最便捷的方式。安装完成后的结果如下图所示:

✅ 步骤三:配置 OpenClaw

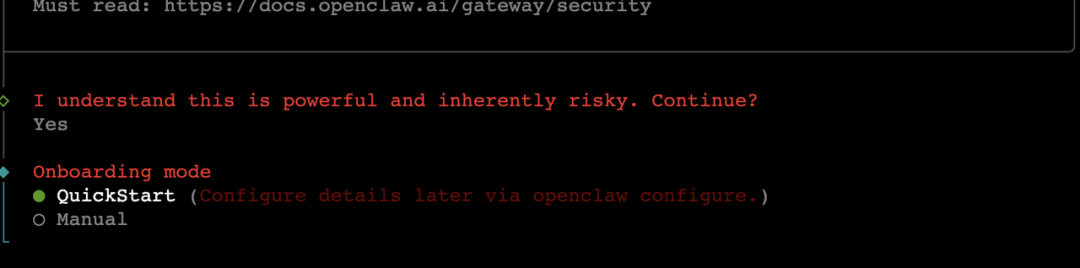

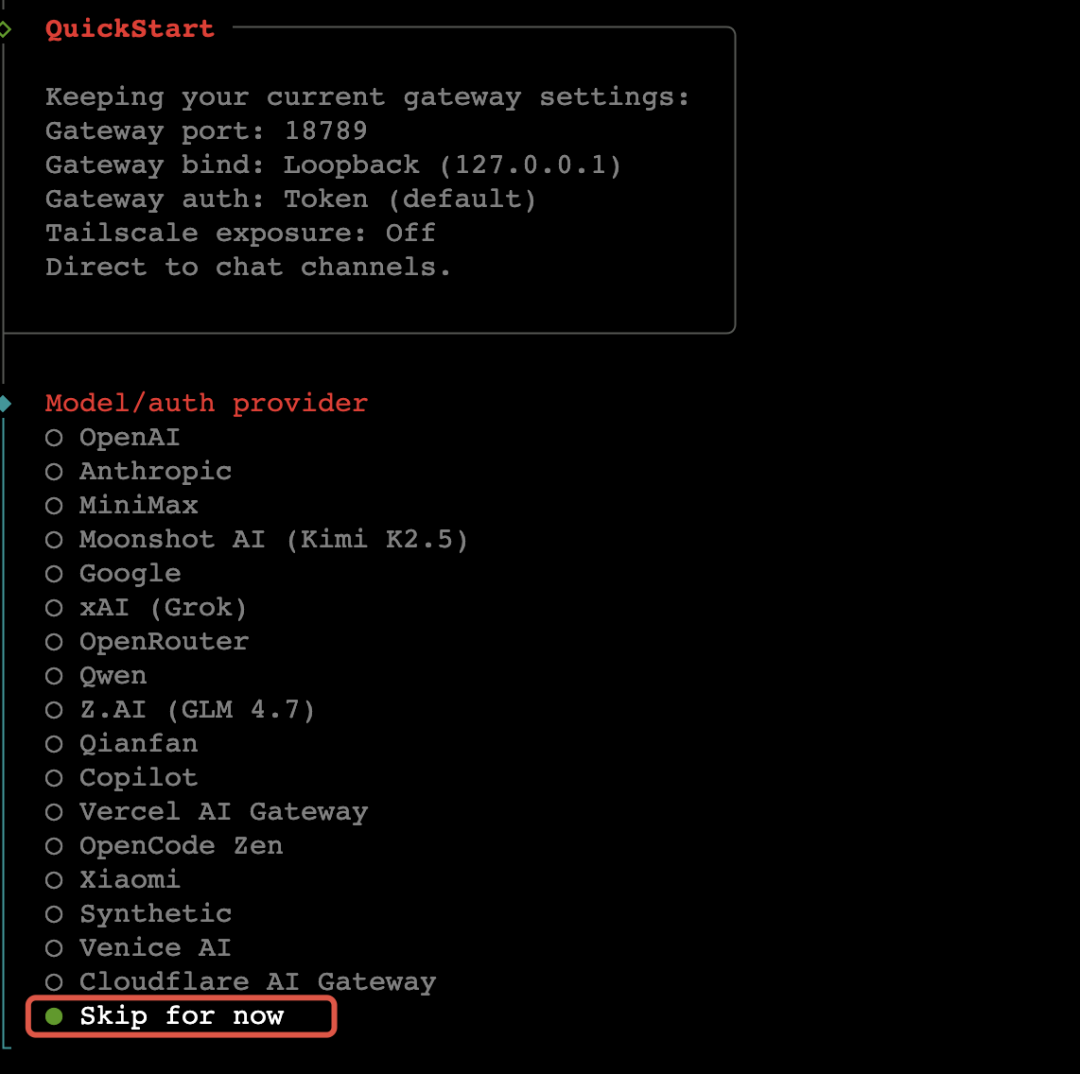

- 通过 Run onboarding 配置 OpenClaw(进入配置后每个配置项通过上下左右来做选择)

openclaw onboard --install-daemon

- 引导流程中选择 Quickstart:

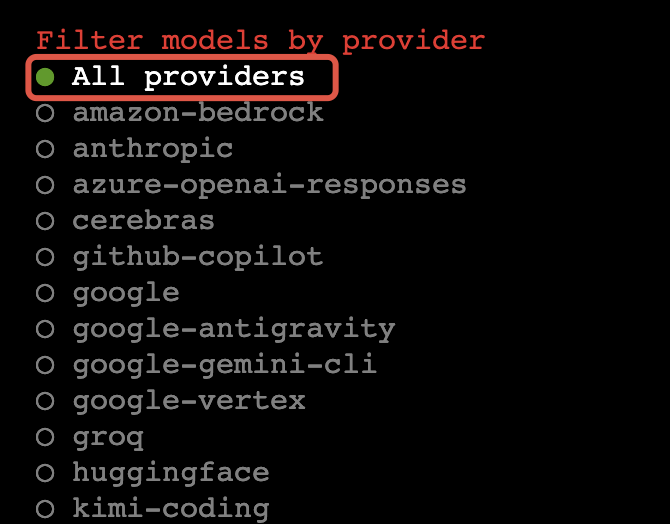

- Model provider 选择 Skip for now,后续通过修改 json 配置文件手动添加:

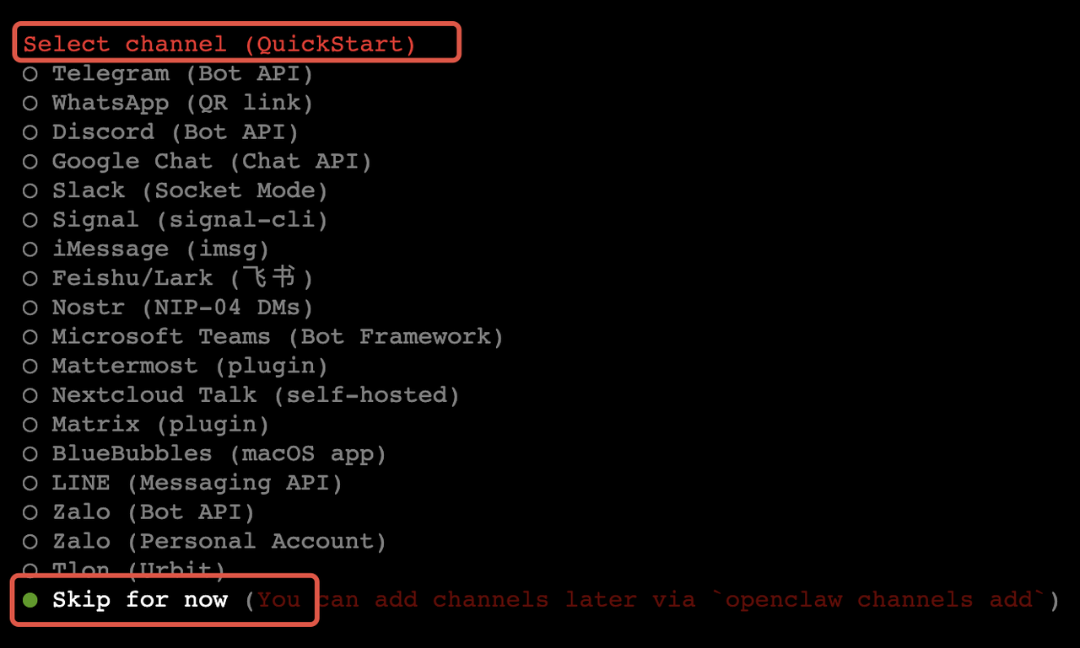

- IM 也选择 Skip for now:

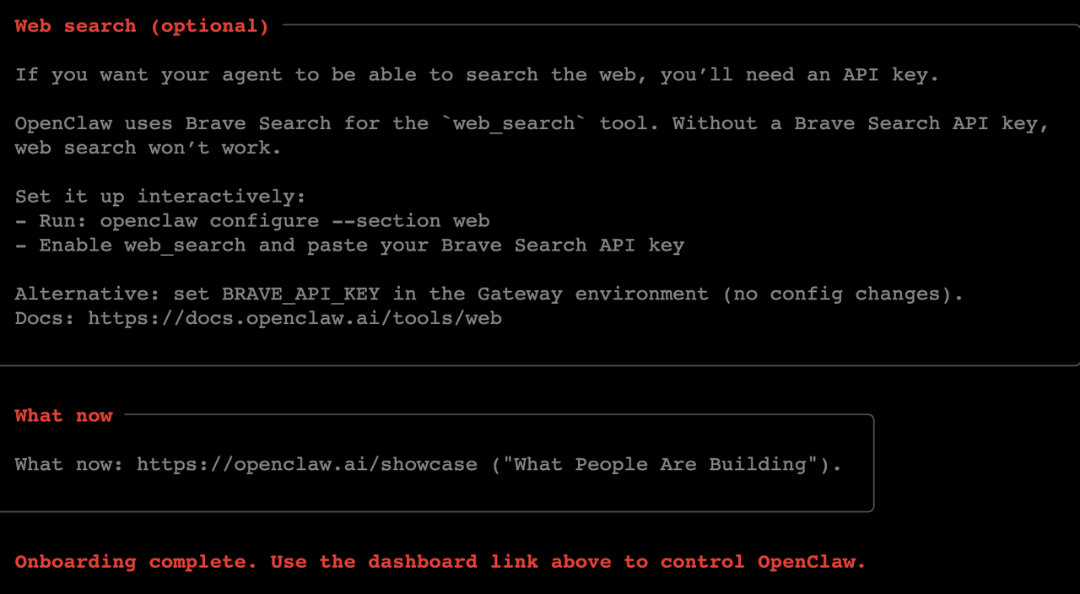

- Skills 选择 Skip for now。 配置完成后如图:

- 如上图所示,既可以通过 ctrl+c 退出配置。

✅ 步骤四:配置端口

- 配置端口转发(注意一定要使用 HTTP 端口转发,服务端口使用 18789 ):

注:以上生成的访问地址后续将要作为访问 WebChat 的地址, 跨域配置也需要使用。

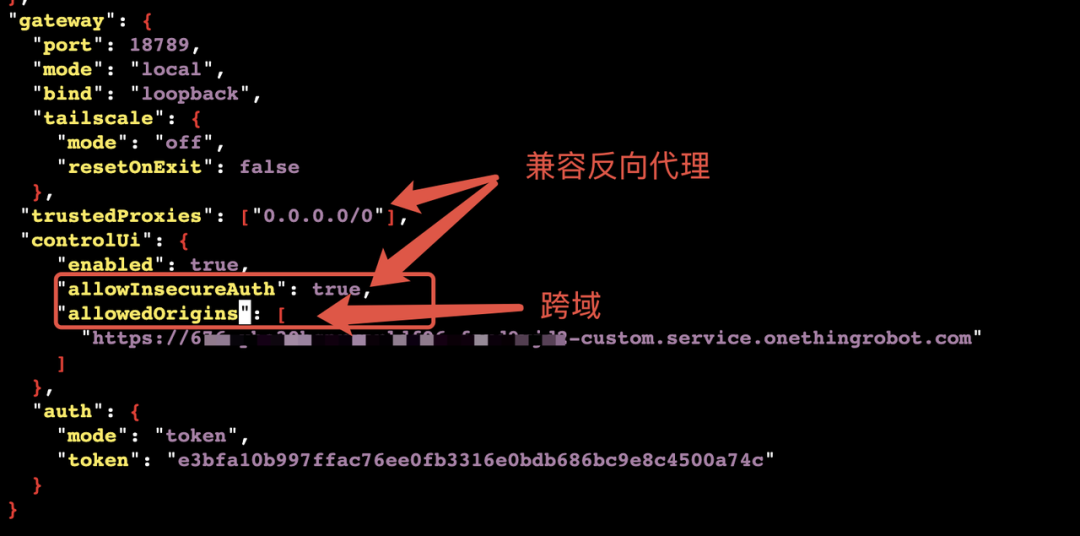

因为通过了端口转发,所以需要在 OpenClaw 的配置文件 gateway 下增加一些配置让 Control UI 允许跨域,允许反向代理的访问:

- 增加 allowedOrigins 这个 key,将上一步生成的访问地址写入;

- 加入 allowInsecureAuth 这个 key 配合 trustedProxies 实现反向代理的兼容。

vim ~/.openclaw/openclaw.json"gateway": { "port": 18789, "mode": "local", "bind": "loopback", "controlUi": { "enabled": true, "allowedOrigins": [ "https://your_url_here" //公网访问生成的访问地址 ], "allowInsecureAuth": true }, "auth": { "mode": "token", "token": "e3bfa10b997ffac76ee0fb3316e0bdb686bc9e8c4500a74c" // 不同的实例有不同的token 不要修改 }, "trustedProxies": [ "0.0.0.0/0" ], "tailscale": { "mode": "off", "resetOnExit": false } }

✅ 步骤五:配置 API

- 配置使用 OneThingAI API。获取 OneThingAI 的 key,该 key 是访问网心 LLM API 所需的。

- 把该 key 写入到 .env 文件:

echo 'ONETHINGAI_API_KEY=your_key_here' >> ~/.openclaw/.env- 编辑 OpenClaw 配置文件, 增加三方 API 供应商:

vim ~/.openclaw/openclaw.json- 增加配置(如需多模型,则仿造 models.providers.models 下增加多项即可)

"models": { "mode": "merge", "providers": { "onethingai": { "baseUrl": "https://api-model.onethingai.com/v2/openai", "apiKey": "${ONETHINGAI_API_KEY}", "api": "openai-completions", "models": [ { "id": "minimax-m2.1", "name": "Minimax M2.1", "reasoning": false, "input": ["text"], "contextWindow": 200000, "maxTokens": 8192 } ] } } }- 设置 Agent LLM 默认值:

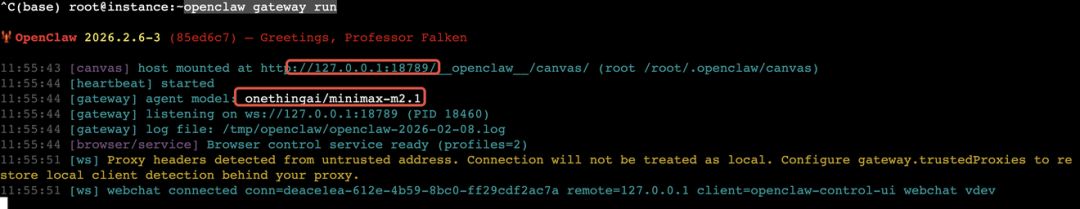

"agents": { "defaults": { "model": { "primary": "onethingai/minimax-m2.1" } } }配置成功后,启动 gateway,并访问公网服务配置生成的访问地址,即可见 WebChat。

因为 OneThingAI 使用容器技术, systemd 不可访问,无法配置 service,需在 shell 前端启动 OpenClaw。

openclaw gateway run启动完成如下:

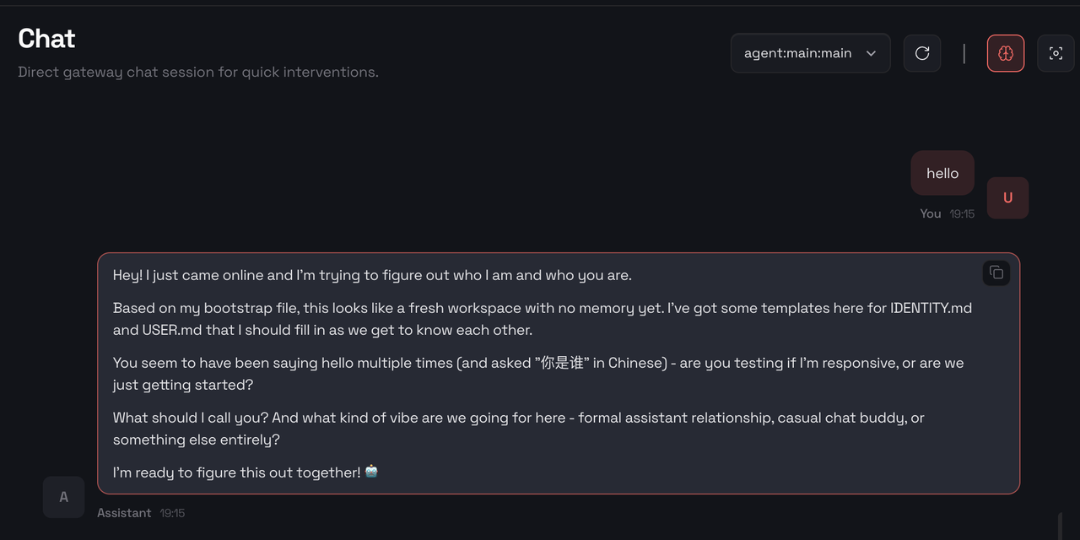

通过浏览器访问 WebChat,测试结果如下图:

✅ 步骤六:配置飞书

通过飞书调用 OpenClaw 的全部能力:

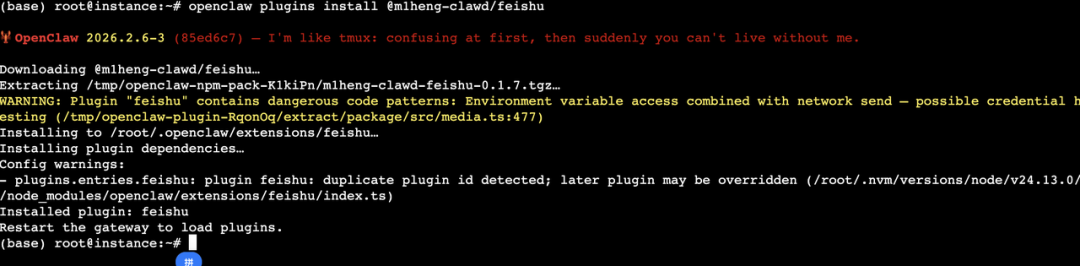

- 在 OpenClaw 中安装飞书集成插件

安装完成:

- 访问 https://open.feishu.cn/ 登录并创建应用。

- 复制 App ID 和 App Secret:

- 批量配置权限:

- 配置 OpenClaw 访问飞书:

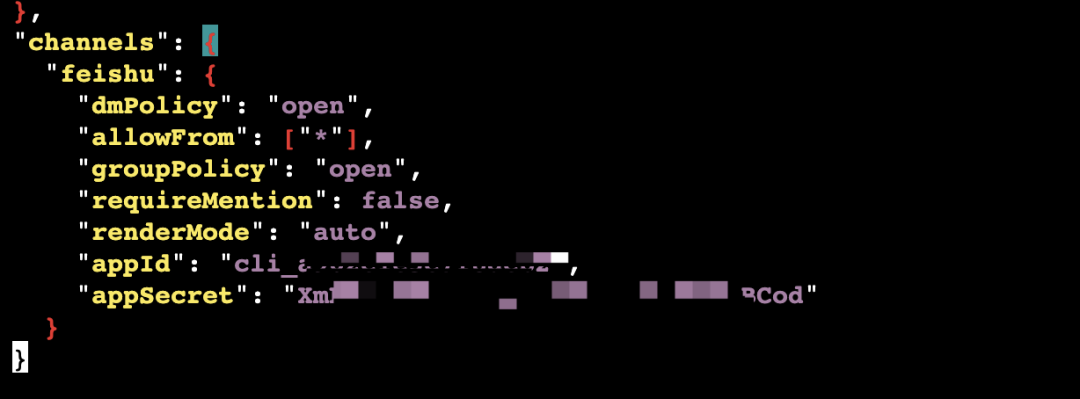

- 确保 OpenClaw 配置文件如下:

- 针对飞书关闭实例 http 代理:

- 如果以上方式有问题则可以运行:

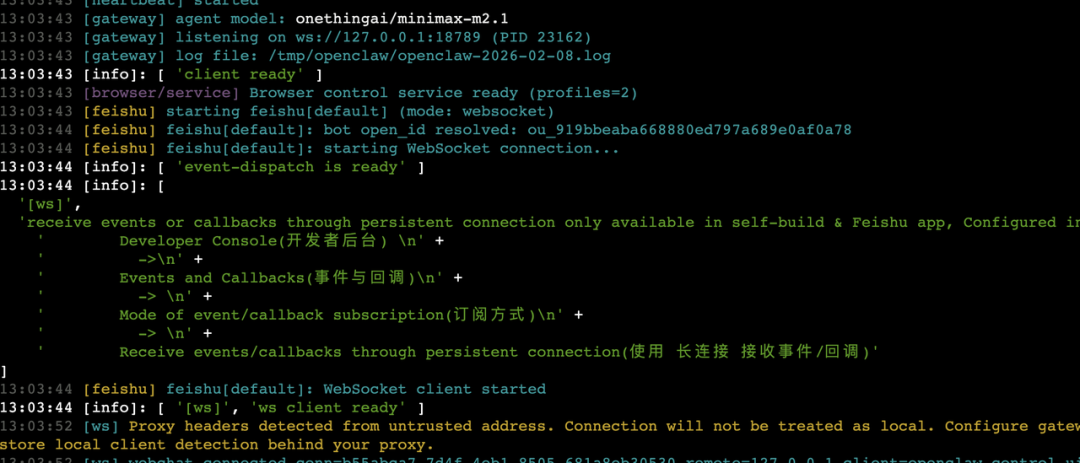

- 启动 OpenClaw :

正确执行后如下:

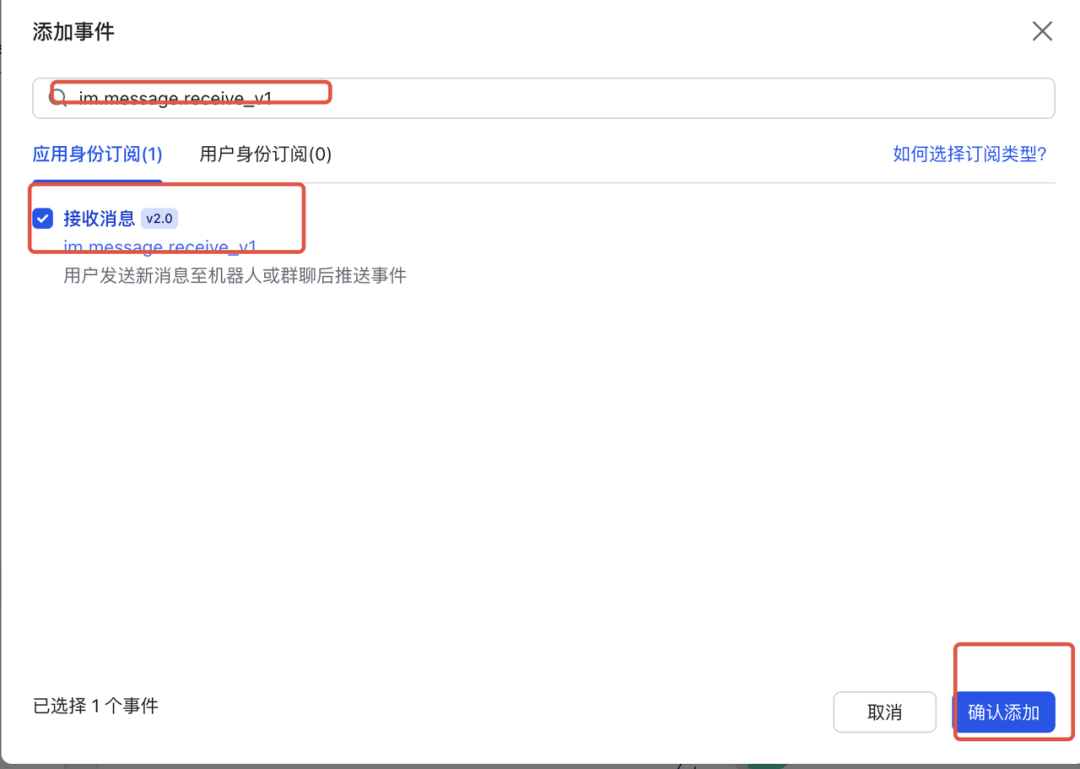

开启长链接:

配置事件:im.message.receive_v1

还可额外添加事件:

im.message.message_read_v1、

im.chat.member.bot.added_v1、

im.chat.member.bot.deleted_v1...

更多飞书插件的使用文档参考:

https://github.com/m1heng/Clawdbot-feishu

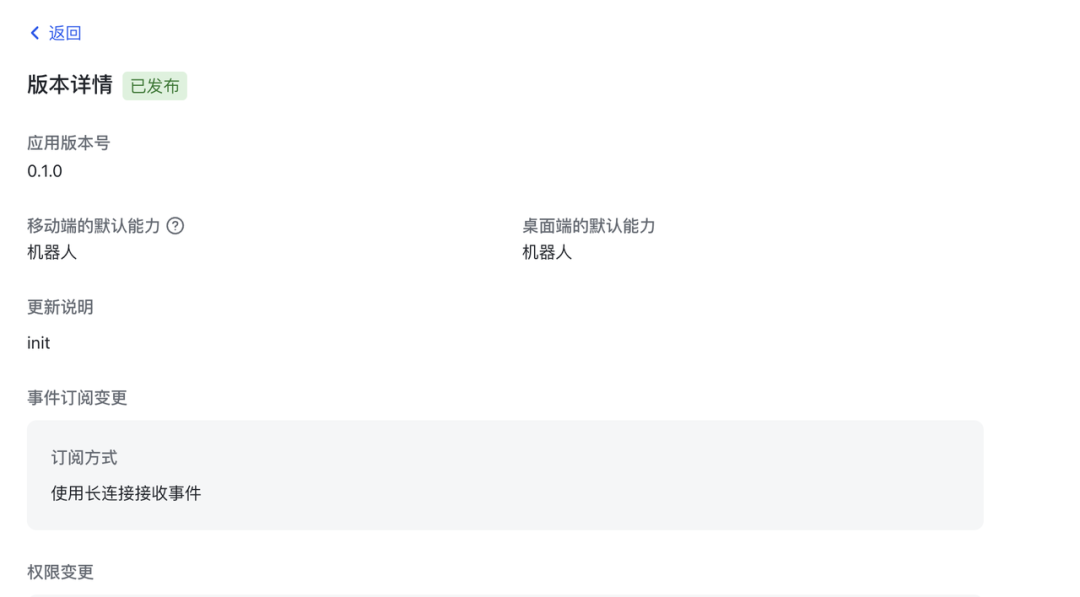

最后,发布应用:

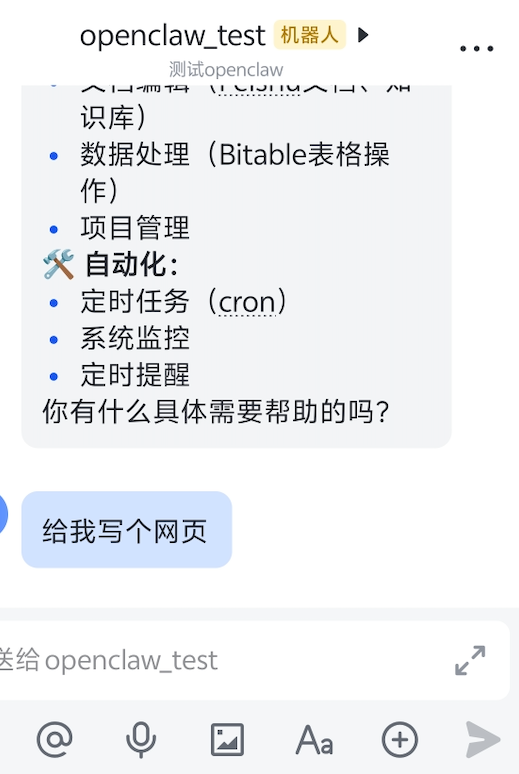

发布后,可在对应账号的飞书 APP 端看到一个新增机器人,叫 openclaw_test:

完成配置后即可通过飞书和 OpenClaw 交流, 也可以实现操作飞书完成客服等工作了。

如需要配合飞书权限的修改,需要认证的企业创建的机器人允许对外共享,则可加入到外部群,参考:

https://open.feishu.cn/document/develop-robots/add-bot-to-external-group?lang=zh-CN

更多配置和开发参考:

https://github.com/openclaw/openclaw

https://docs.openclaw.ai/

需注意:国内很多场景使用微信和企业微信,由于官方并没有提供很好的 API 支持,想要使用以上平台需要一些 hack,可以通过 wechaty,langbot 等来实现访问操作。此处可能存在被封禁的风险,需谨慎操作。

https://github.com/wechaty/wechaty

https://github.com/langbot-app/LangBot