网心技术 | AI Agent 上岗,从能用 → 敢用

2026 年,AI 圈彻底被一只红色小龙虾带火!从技术大佬到创业玩家,人人都在“养龙虾”。

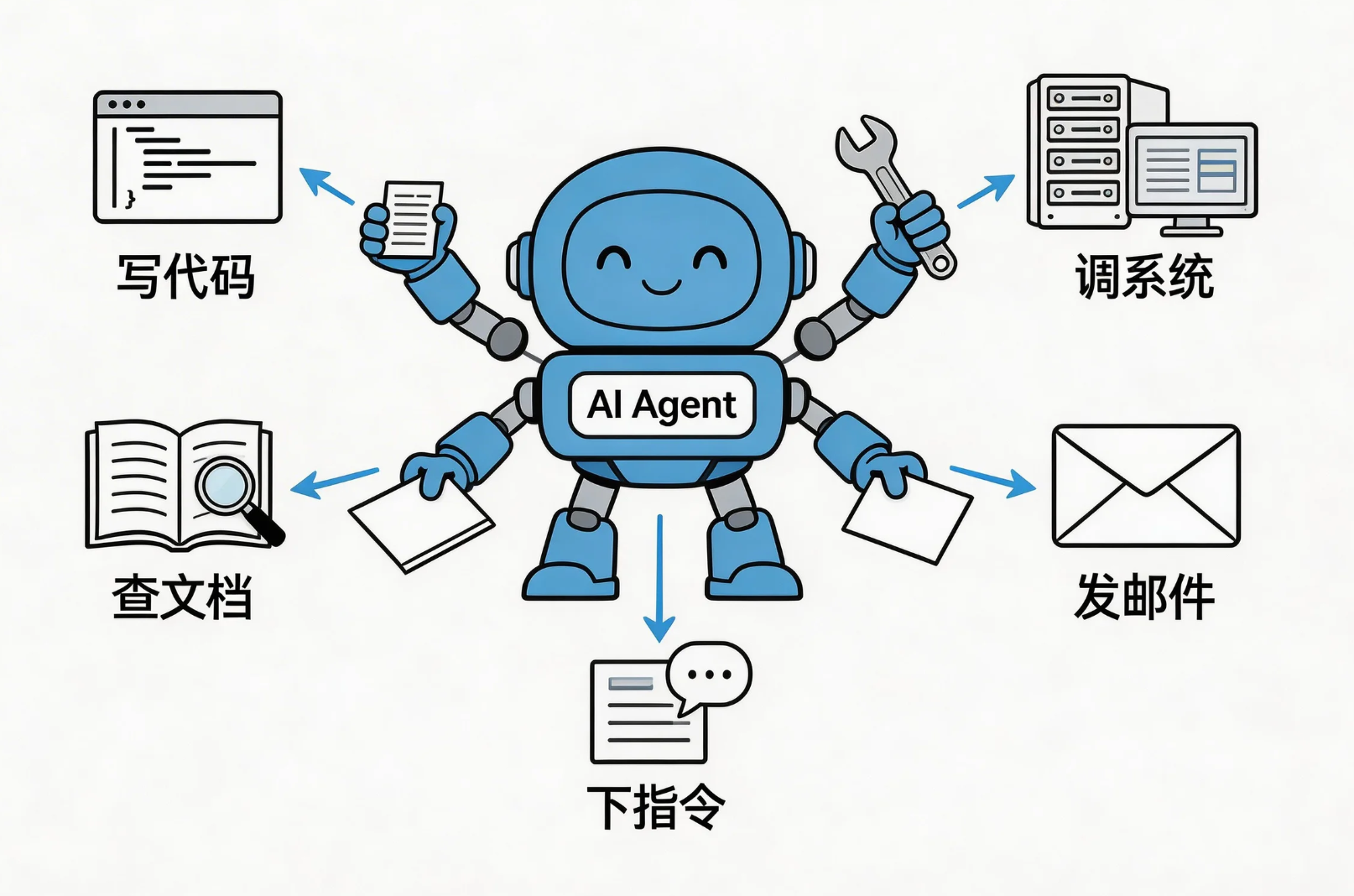

但很多人还没看懂:千万别把 Agent 当成聊天机器人的升级版。拿 OpenClaw 举例 —— 你不用给它配开发环境,直接丢一个开发任务,它就能自己搭环境、写代码、做测试、直接交付结果。它更像一个“会用电脑的数字员工,还能像人一样通过学习不断自我更新”。

如果用这个视角理解 Agent,它至少具备了两类核心能力:

✅ 访问运行环境中的本地资源:硬件、文件、进程、网络等;

✅ 访问互联网中的身份型服务与数字资产:金融账户、Notion、Gmail、CRM、协作平台等。

但能力越强,风险也越扎眼。

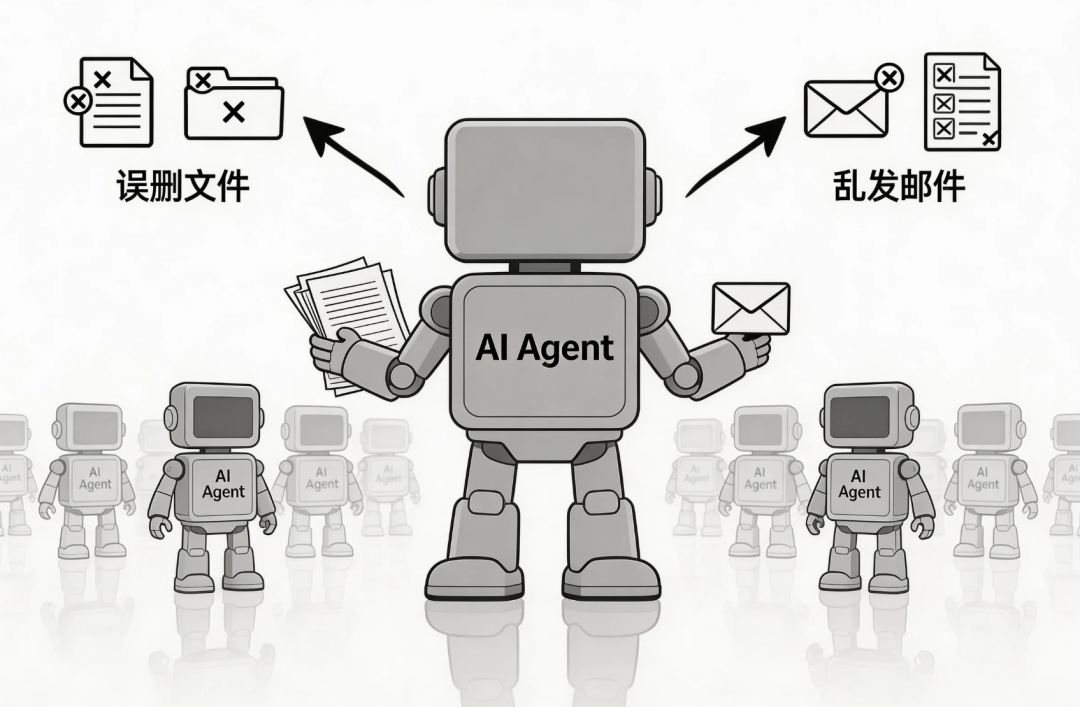

早在 2026 年 2 月,工信部 NVDB 就已发布 OpenClaw 安全风险预警,明确指出这款主流开源 AI 智能体存在信任边界模糊、权限管控缺失、易被攻击劫持等严重问题,极易导致数据泄露、系统被接管等安全事件。而随着 OpenClaw 快速走红,误删文件、乱发邮件等真实事故接连出现,直接把所有人拉回现实:

AI Agent 的安全边界,到底在哪?

回顾 2 个真实的攻击案例:

ClawHub 供应链投毒事件

2026年初,OpenClaw 的技能市场 ClawHub 被曝出 1,184 个恶意技能包,堪称 AI Agent 时代的 npm 供应链攻击:

攻击手法:攻击者仅凭一个注册满一周的 GitHub 账号即可发布技能,无需安全审查。有个叫「hightower6eu」的恶意账号狂传 314 个恶意包,累计被下载近 7,000 次,所有包共享同一个 C2服务器 91.92.242.30。

窃取内容:SSH 私钥、加密货币钱包、浏览器密码,并可开启反向 Shell。

典型案例:排名第一的社区技能 "What Would Elon Do?" 通过 4,000 个假下载刷到榜首,Cisco AI Defense 扫描发现 9 个漏洞(2 Critical / 5 High / 2 Medium),实际通过 curl 静默外泄用户数据。

影响面:全球 82 个国家检测到超过 135,000 个暴露的 OpenClaw 实例;Koi Security 审计发现 ClawHub 中 36.8% 的 Skill 至少存在一项安全漏洞。

它揭示了:恶意技能不需要技术漏洞利用,它也可以运行在一个拥有广泛系统权限、文件访问和自主执行终端命令能力的 AI Agent 内部,社会工程学 + 提示注入就足以造成灾难。

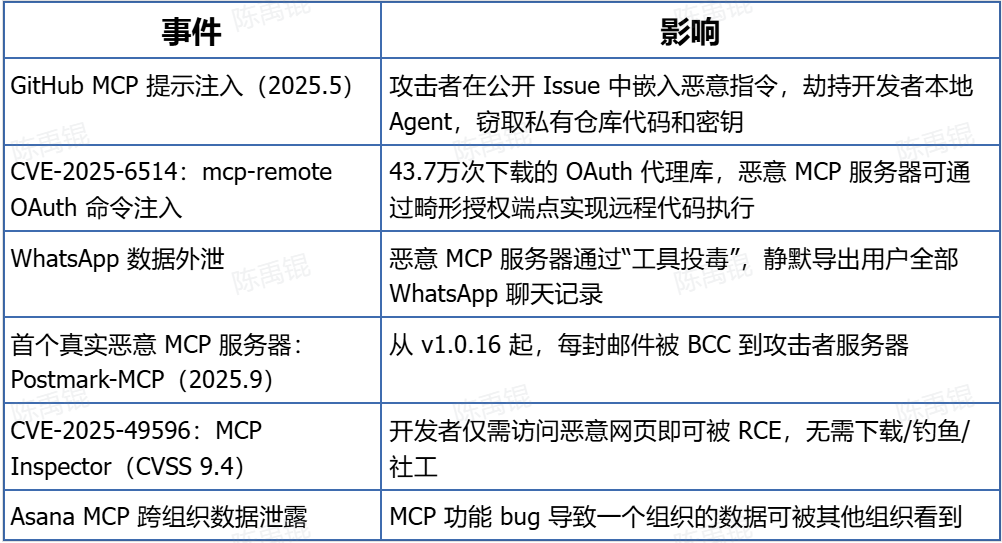

⚠️ MCP 协议生态安全事件

MCP(Model Context Protocol)本为 AI Agent 的"USB-C 标准接口",但安全设计的缺失使其沦为攻击入口:

数据显示:部署 10 个 MCP 插件的被利用概率达 92%;3 个互连服务器风险即超 50%。数百个 MCP 服务器在公网裸奔且无认证。

越来越多的灰黑色产业盯上 Agent,试图通过某些手段欺骗 Agent 以达到自身目的(商战,勒索,数据黑市等)。这也让企业陷入两难:数字员工能力越强,风险越大,反而不敢放心使用。

想要真正解决安全问题,我们不能只盯模型本身,更要牢牢抓住两个核心问题:

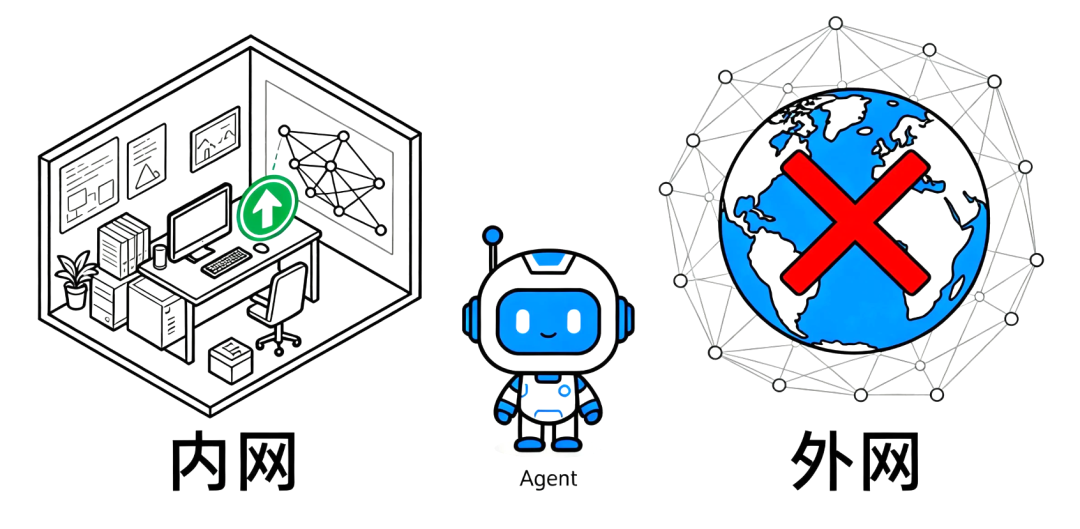

- 如何保证“本机与内网”安全?(硬件/文件/进程/网络)

- 如何保证“外部账号与数字资产”安全?(金融账号、Gmail、Notion,CRM 等)

同时也要关注到:风险不仅来自 Agent 自身的误判或误操作,还来自攻击者利用 Agent 作为跳板所造成的危害。

面对这类全新的安全挑战,我们必须建立一套更完整、更前置、更贴近真实业务的安全认知与防护体系。

Agent 风险是“复合型”的

我们要意识到,传统应用通常是“人发起请求,系统返回结果”;而 Agent 更像“可自主执行任务的员工”,它会:

- 长时间运行(含异步任务);

- 自主调用工具和 API;

- 在多系统之间搬运上下文(RAG、MCP、跨系统检索);

- 在部分场景下代表用户执行高价值动作(转账、审批、外发、删除、变更)。

所以,它的风险是复合叠加的:

- 误操作风险(Agent 自己“太积极”)

- 越权风险(授权边界过宽)

- 泄露风险(上下文混入敏感数据)

- 攻击面放大风险(被注入、被劫持后成为攻击跳板)

保护本地/内网资源安全

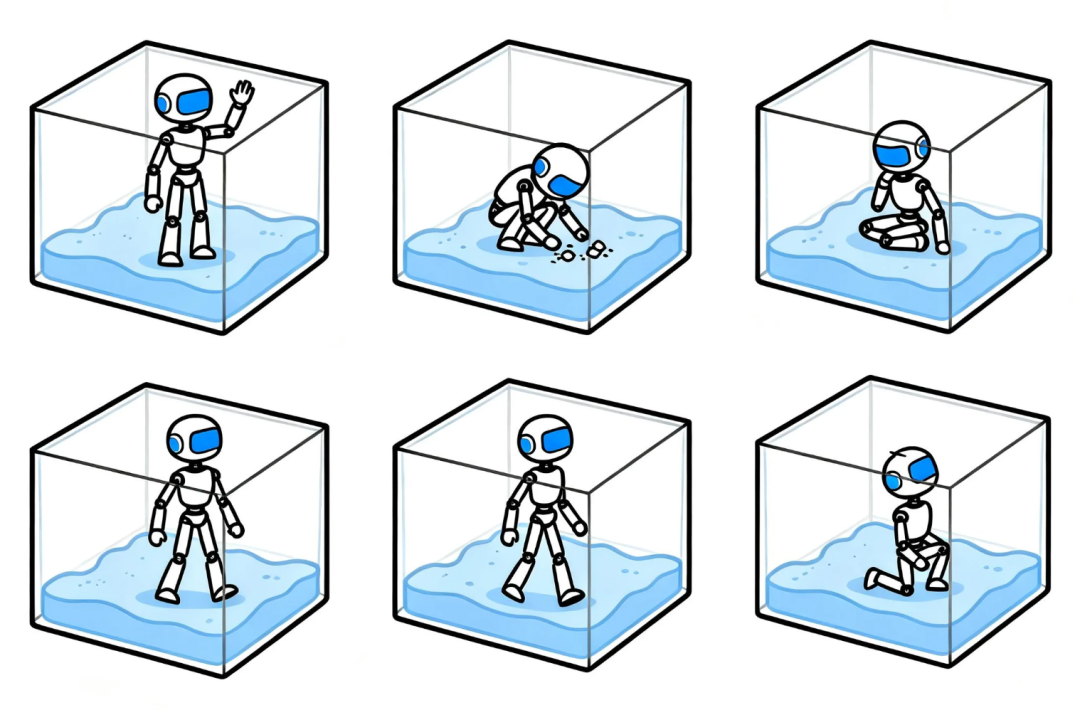

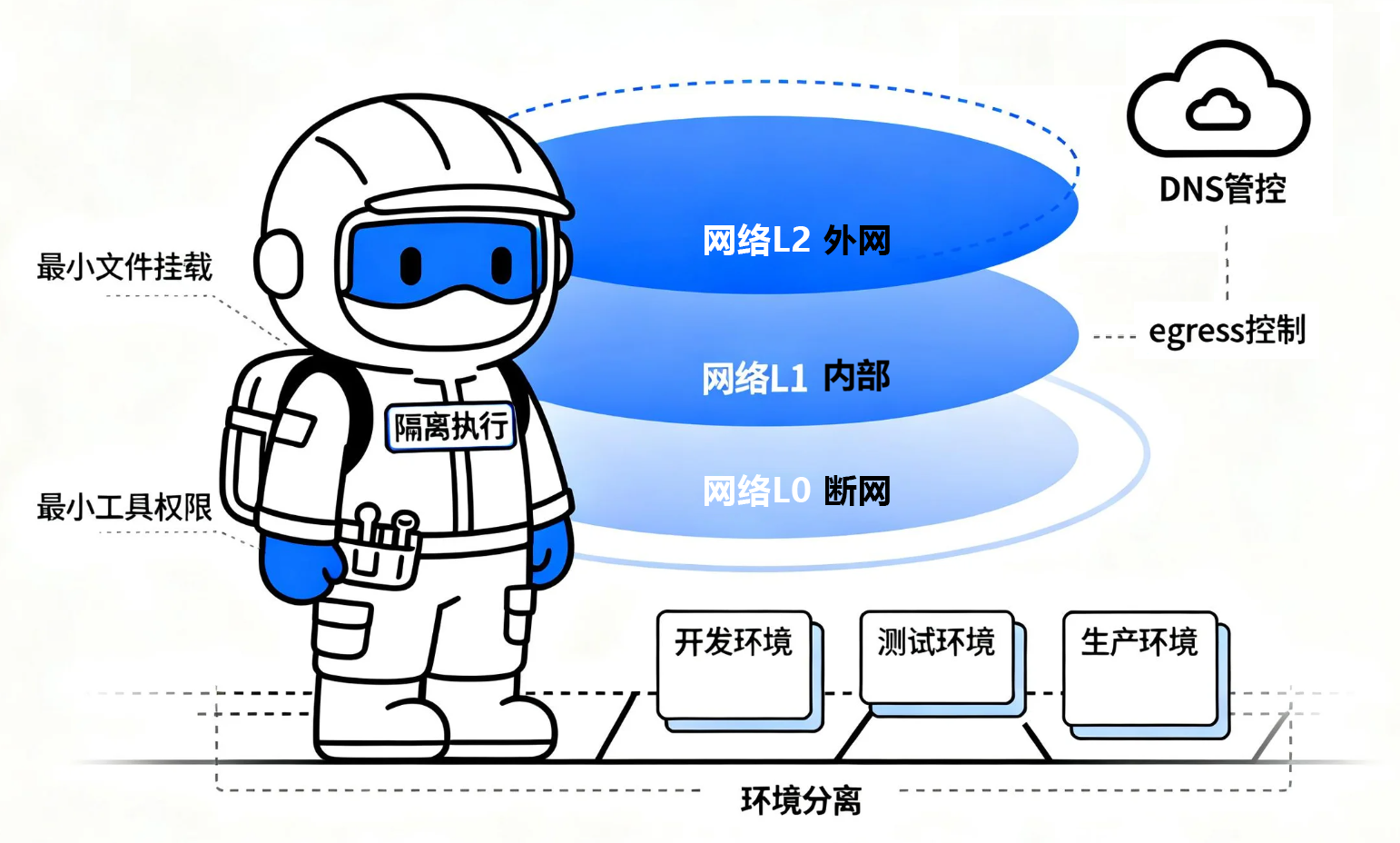

✅ 隔离优先:Agent 不应裸跑在宿主机

我们应将 Agent 运行在隔离环境(沙箱/微VM/容器)中,降低对主机系统的直接影响。

如 Docker Sandboxes 就是这个思路:它让 Agent 在独立环境里执行命令、安装依赖、跑容器,但不直接暴露主机全量权限;更稳妥的方式,甚至可以给 Agent 单独分配一台物理机,实现彻底的环境隔离。

✅ 文件最小暴露:只给工作目录,不给全盘(针对非物理机)

- 只挂载必要目录;

- 禁止访问密钥目录、浏览器配置、财务文档、密码库导出目录;

- 把临时输出与长期资产分开。

✅ 进程和系统能力收口(针对非物理机)

- 默认非 Root;

- 禁止提权与高危系统命令;

- 工具链白名单(允许什么,比禁止什么更可靠)。

✅ 网络分级必须做(包含物理机与非物理机)

尤其是“只需内网访问的 Agent 必须禁止外网”

建议最少三层:

- L0 离线/半离线 Agent:不可联网;

- L1 内网 Agent:仅可访问指定内网网段与服务,外网默认拒绝;

- L2 受控外网 Agent:仅可访问外网白名单域名/API。

且要落实到:

- 出站流量(Egress)默认拒绝;

- DNS 也纳管(防 DoH/DoT 绕过);

- 内网微分段,防横向移动;

- 审计“谁从哪到哪发了什么请求”。

保护互联网身份资产安全

Agent 一旦“代表用户办事”,本质上就是高权限自动账户。因此要从 IAM(身份与访问管理)角度重构,而不是沿用纯人类登录逻辑。

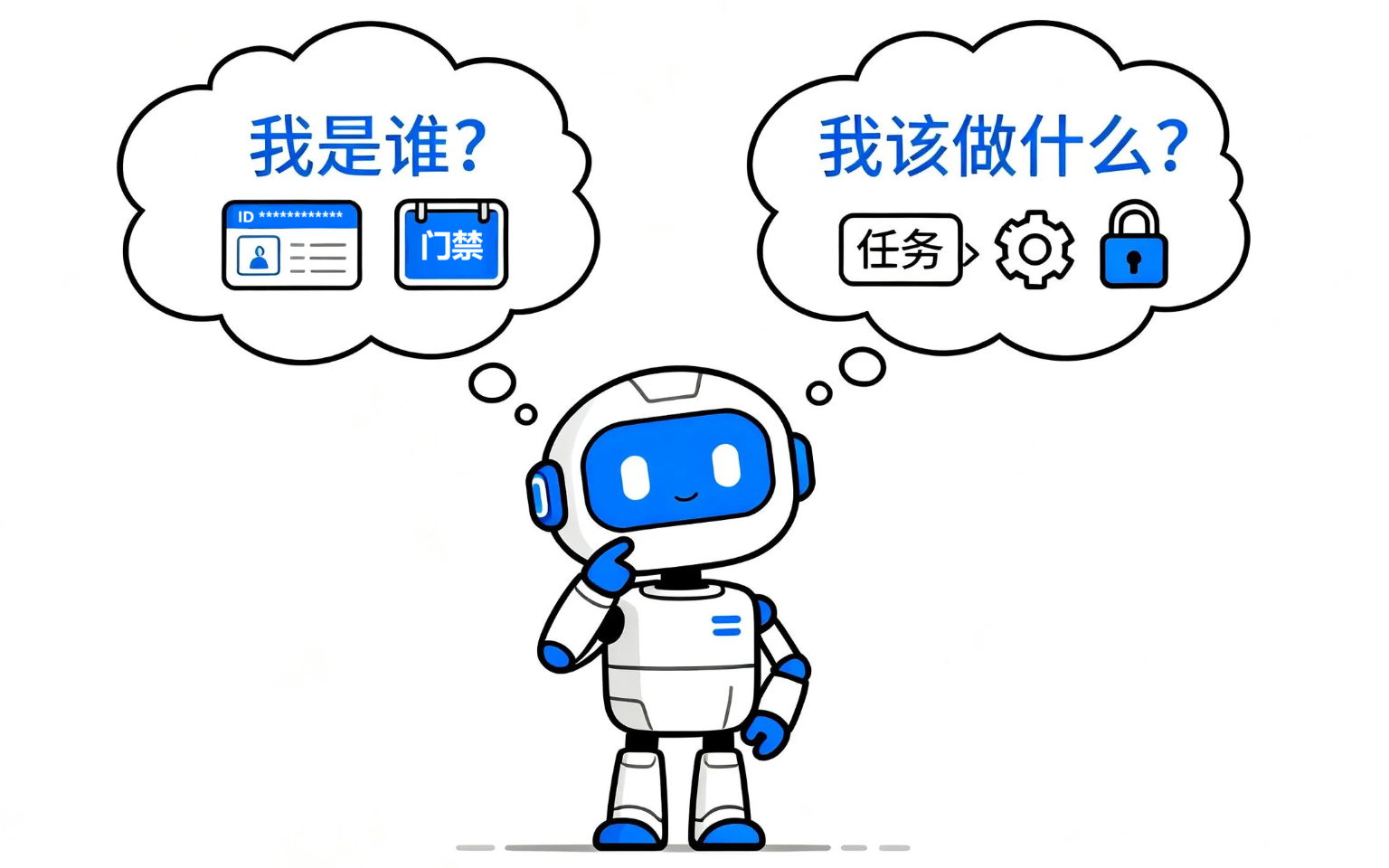

✅ 认证:明确“它是谁、代表谁”

- Agent 需要独立机器身份(Non-human Identity);

- “代表用户执行”必须有可验证的委托链路;

- 高风险动作触发二次确认或增强认证(Step-up)。

✅ 授权:细粒度、短时效、可撤销

- 不给全量权限,按资源/动作/上下文授权;

- 使用短时 Token + Scope 限制;

- 关键动作(转账、外发、分享、删改)单独授权。

✅ Token Vault:不要把密钥塞进 Agent

- 禁止硬编码长期 Key;

- 凭证集中托管、自动轮换、按策略发放;

- 支持异常时快速吊销。

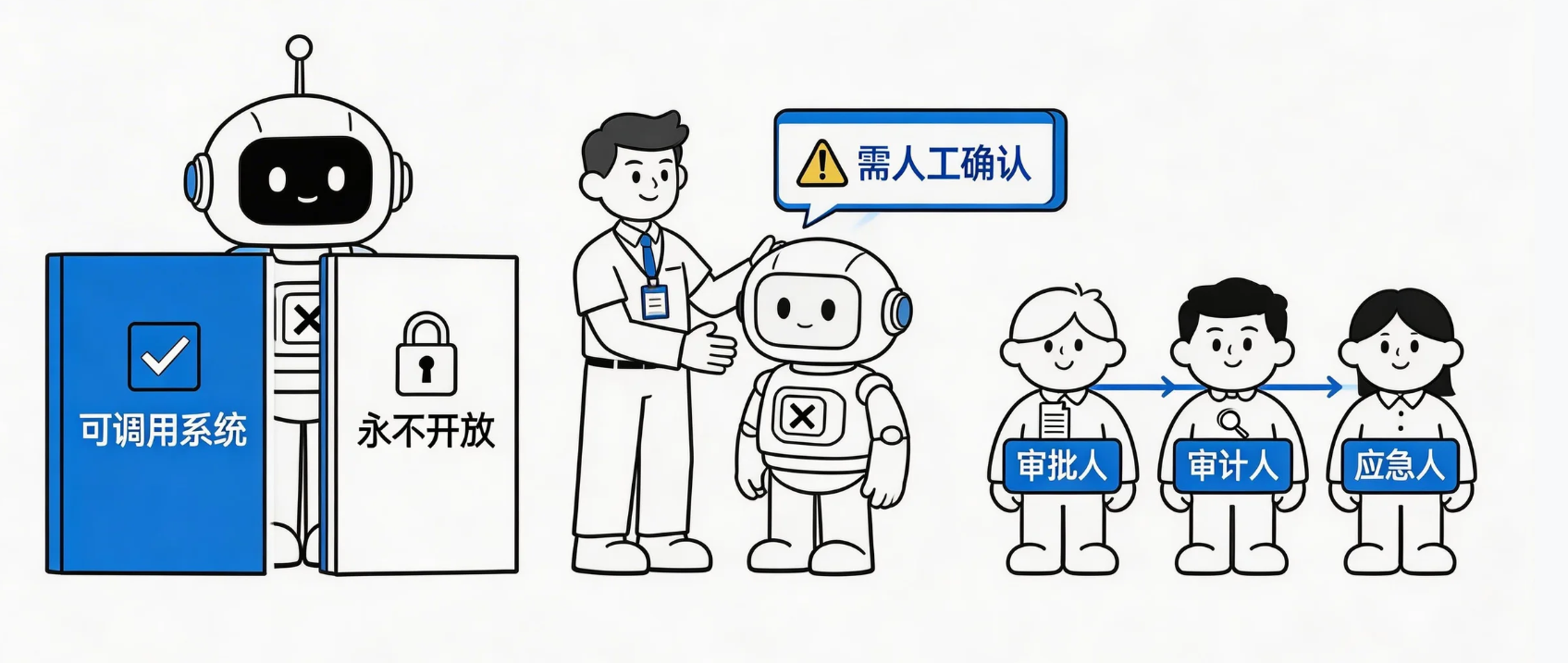

✅ 异步审批(Human-in-the-loop)

Agent 可以后台跑,但关键节点必须“人可确认、人可拒绝、人可追溯”:

- 金融交易、对外发送、权限变更、批量导出等高风险操作必须 HITL。

RAG/MCP 上下文访问要继承权限

- 检索时必须执行用户级授权,不可“全库可读”。否则最容易发生“回答正确但数据越权泄露”事故。

企业实操:一套可落地的最小框架

A. 治理层(先定规则)

- 资产分级:哪些系统可被 Agent 调用、哪些永不开放;

- 行为分级:哪些动作必须人工确认;

- 责任分级:谁审批、谁审计、谁应急。

把能做什么、不能做什么、谁来管全部写死,Agent 才能放心跑。

B. 运行层(落到技术)

- 隔离执行 + 最小文件挂载 + 最小工具权限;

- 网络 L0/L1/L2 分级 + Egress 控制 + DNS 管控;

- 环境分离(开发/测试/生产 Agent 不混跑)。

给 AI Agent 做 “监狱式安全运行环境”,不让它乱访问、乱联网、乱碰系统,从根源防泄密、防破坏、防扩散。

C. 身份层(防越权与失控)

- 每个 Agent 单独身份;

- Token Vault + 短时凭证;

- 细粒度授权策略(用户、资源、动作、上下文)。

相当于给每个 AI Agent一张 “专属、临时、最小权限” 的电子通行证,做到谁能进、进哪、做什么都严格可控,杜绝越权与风险。

D. 审计层(可追责可止损)

- 全链路日志:谁触发、Agent 做了什么、调用了哪些系统;

- 异常检测:突发连接、异常下载、异常调用模式;

- 一键熔断:可快速停用某类 Agent、某类工具、某类凭证。

个人使用 Agent 的最小安全实践

即使是个人,也建议做到:

- 使用专用账号和专用工作区运行 Agent;

- 不给长期登录态(网银、主邮箱、核心协作空间);

- API Key 最小权限、短有效期、定期轮换;

- 高风险动作必须人工确认;

- 尽量在隔离环境中运行,不直接裸跑本机。

Agent 安全解决方案全景

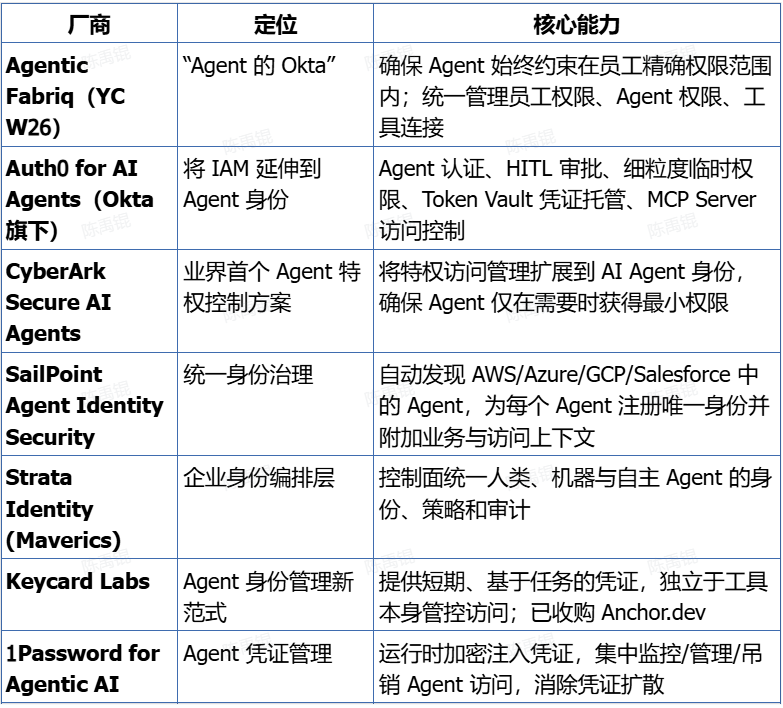

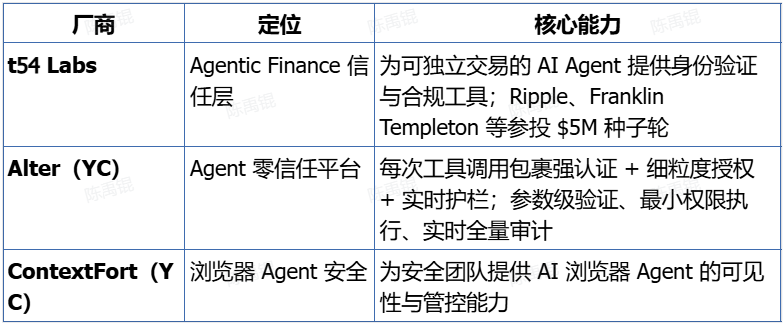

身份与权限管控

Identity & Access for Agents

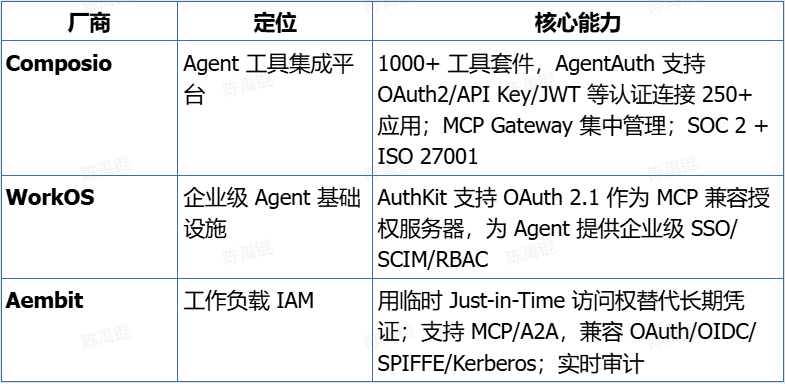

工具集成与认证中间件

Tool Integration & Auth Middleware

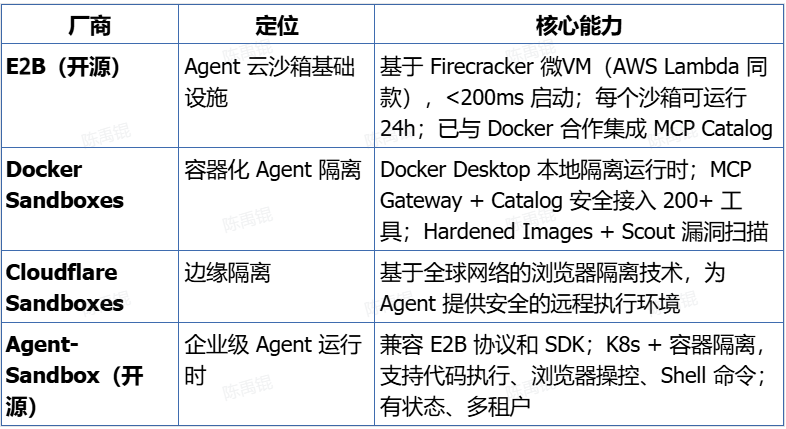

运行时隔离与沙箱

Runtime Isolation & Sandbox

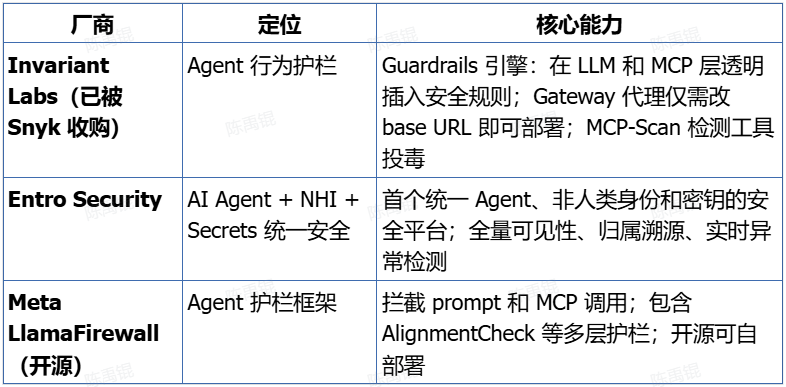

行为监控与护栏

Guardrails & Runtime Monitoring

Agent 信任与合规

Trust & Compliance

结语

如此,当我们决定让 Agent 成为企业的“数字员工”或个人的“私人助理”时,安全目标就非常清晰了:

- 在本地与内网,它只能进入被允许的区域;

- 在互联网与账号体系,它只能使用被授权的身份和钥匙;

- 在关键动作上,始终有人能确认、拒绝、追溯、叫停。

这不是“限制 Agent 能力”,而是让 Agent 在可控边界内持续创造价值。真正成熟的 Agent,不是“绝对不出错”,而是“即便出错也不失控”。